Hace semana y media, Daniel Moreno Gama, de 20 años, arrancó su coche para recorrer los más de 3.000 kilómetros que separan su hogar, en la periferia de la ciudad de Houston, del exclusivo barrio de Russian Hill, en San Francisco. Su objetivo … era, presuntamente, acabar con la vida de Sam Altman, principal ejecutivo de OpenAI, firma creadora de ChatGPT. Al llegar, en la madrugada del viernes, preparó un cóctel molotov y lo lanzó contra la fachada de la mansión del magnate. Tras esto, volvió a ponerse al volante con el fin de prenderle fuego a la sede de OpenAI. Fue detenido por la policía a las cuatro de la mañana. No causó ningún herido.

Según la prensa local, el veinteañero llevaba encima una nota en la que afirmaba que la inteligencia artificial destruiría el mundo. En ella también se dirigía directamente a Altman, a quien pedía que si «por un milagro» conseguía sobrevivir, lo tomara como «una señal divina para redimirse» de sus actos. En redes sociales como Instagram, varios usuarios elogiaron el intento de asesinato. «Un héroe ha nacido», señalaba un internauta. «Más, más, más», pedía otro. «La gente está cansada», sentenciaba un tercero, que llamaba a la «revolución».

MÁS INFORMACIÓN

Expertos en inteligencia artificial consultados por este periódico censuran por completo el atentado contra el alto ejecutivo. «Es completamente injustificable», remarca a ABC Pablo Haya Coll, director del área de Business and Language Analytics en el Instituto de Ingeniería del Conocimiento e investigador del Laboratorio de Lingüística Informática de la Universidad Autónoma de Madrid. Sin embargo, reconoce el surgimiento de una creciente brecha entre la sociedad y las empresas que, actualmente, invierten miles de millones en cambiar el mundo con la IA. La preocupación por los efectos negativos de esta tecnología cada vez es más grande; sobre todo entre los jóvenes, que temen que sus carreras profesionales puedan verse laminadas antes, incluso, de haber comenzado.

«El futuro da miedo»

El pasado lunes, la Universidad de Stanford publicó un estudio en el que la ruptura entre los ejecutivos y el ciudadano de a pie queda patente. Según se recoge, mientras que el 84% de los expertos en inteligencia artificial esperan que la IA mejore la atención médica, solo el 44% de los ciudadanos estadounidenses esperan que sea así. La diferencia de expectativas es mayor todavía en economía (-69% frente a 21%), respectivamente- o en trabajo (73% y 23%).

Otro estudio, en este caso publicado hace un mes por el centro de investigación estadounidense Pew Research, destacaba en sus resultados que solo el 10% de la sociedad norteamericana está más entusiasmada que preocupada por el creciente uso de la IA. Y en España los resultados no son muy diferentes. Según un reciente análisis de la Fundación BBVA, la mitad de la población nacional afirma estar «preocupada» por el avance de la tecnología. Solo el 16% señala que «le entusiasma».

Solo el 10% de la sociedad estadounidense está más entusiasmada que preocupada por la IA. En España, el porcentaje es del 16%

«No me sorprenden estos resultados», explica a este periódico Ulises Cortés, catedrático de Inteligencia Artificial en la Universidad Politécnica de Cataluña y experto en ética: «Estas máquinas pueden resolver grandes problemas, pero por otra parte el coste que exigen a la sociedad es altísimo».

Respecto a los detonantes, el experto llama la atención sobre la pérdida de empleos -que ya se está dejando notar-, la bajada en la calidad de la información que hay en la red, debido al creciente uso de la IA para generar contenido, al «enorme consumo de electricidad» de los centros de datos -imprescindibles para el uso de herramientas como ChatGPT- o al potencial daño que la tecnología puede hacerle a la democracia debido a su uso para la generación de desinformación: «El futuro da miedo, nos lo da a todos».

A diferencia de los ejecutivos, la mayoría de la sociedad no cree que la tecnología vaya a mejorar el trabajo, la atención médica o la economía

En Estados Unidos, las protestas contra las grandes tecnológicas son cada vez más frecuentes, especialmente por la construcción de nuevos centros de datos vinculados al auge de la inteligencia artificial. En distintos puntos del país, como Georgia, Maryland o Míchigan, se han producido en las últimas semanas movilizaciones vecinales, demandas judiciales e incluso votaciones locales para frenar proyectos por su elevado consumo de agua y electricidad, el ruido, el impacto ambiental y las ventajas fiscales concedidas a las compañías.

Fallos en la narrativa

Haya Coll reconoce que las preocupaciones existentes en el sector de la IA «no han tenido relación» con las que tiene la ciudadanía: «En el sector hay mucha preocupación por la futura llegada de una superinteligencia y el peligro de que la IA se vuelva incontrolable y pueda crear peligros existenciales. Sin embargo, el ciudadano de a pie tiene una percepción diferente, que es la de la pérdida de los puestos de trabajo y que los impactos que va a tener la tecnología no van a favorecerle».

El directivo explica que existen fallos en la narrativa de los líderes de las grandes empresas de IA. Igual que un día dicen que las máquinas serán capaces de curar cualquier enfermedad imaginable, al siguiente alertan del peligro de que la tecnología acabe dejando a buena parte de la población sin trabajo. Un problema que los propios magnates han comenzado a detectar y reconocer. Entre ellos, el propio Altman.

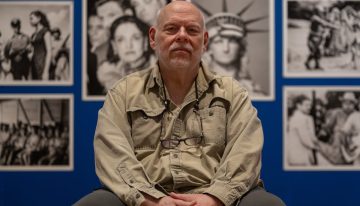

Daniel Moreno, el sospechoso de atentar contra Altman fue captado por una cámara.

(Efe)

Poco después del ataque, el CEO compartió en su blog personal una fotografía de su marido y su hijo y, tras destacar que espera que la imagen «disuada a la próxima persona de lanzar un cóctel Molotov» contra su casa, reconoció que, quizá, ha «subestimado el poder de la narrativa». También afirmó comprender la preocupación de la sociedad: «Esto es totalmente válido, y agradecemos las críticas constructivas y el debate. Comprendo el sentimiento antitecnológico y, evidentemente, la tecnología no siempre beneficia a todos».

Previamente, OpenAI realizó otra publicación en la que lanzaba un buen puñado de propuestas políticas destinadas a mejorar la imagen de la empresa ante el usuario medio. Entre ellas, el establecimiento de cuatro días de trabajo a la semana y la creación de un fondo dedicado a compartir la riqueza generada por la IA con la sociedad. Por su parte, Anthropic ha creado recientemente un grupo de trabajo dedicado a estudiar cómo la IA puede convertirse en una amenaza para el empleo y la población. El tiempo dirá si estos movimientos acaban concretándose en algo positivo para una sociedad que mira al futuro con pesimismo. Incluso con temor.