Imagina una máquina más lista que el humano más listo; una que no se limite a calcular probabilidades antes de responder a tus solicitudes, sino que piensa casi como una persona. Que entiende realmente el lenguaje, resuelve problemas complejos, toma decisiones, y lo hace todo … sin cansancio, sin distracciones y sin egos. Pero sí con la frialdad y la eficiencia necesarias para dirigir, hasta en solitario, compañías con ingresos anuales de miles de millones de euros. O curar cualquier enfermedad. O crear nuevos materiales. El límite, prácticamente, sería el cielo.

En los últimos años, un ramillete de tecnológicas ha comenzado a avanzar en el desarrollo de esta idea a través de una forma de IA tan poderosa que se la conoce como superinteligencia. Algunas aseguran que podrían alcanzarla en unos pocos años, incluso en el próximo lustro. Pero la mayoría de investigadores y expertos lo ven muy poco probable; y eso siendo optimistas.

Un reciente estudio de la Asociación para el Avance de la Inteligencia Artificial (AAAI), en el que participaron 475 investigadores de la comunidad científica, señala que el 77 % de los expertos considera poco o muy poco probable que esta máquina –capaz de pensar como los humanos y hasta superarlos– pueda lograrse a partir del enfoque actual que siguen empresas como OpenAI, responsable de ChatGPT, o Google. Estas compañías basan su progreso principalmente en ampliar la cantidad de datos y la escala de los modelos con los que entrenan sus sistemas, una estrategia que, según muchos científicos, podría no ser suficiente. Y mucho menos si se quiere conseguir el hito en los próximos años, que es lo que esperan gurús de los algoritmos como Sam Altman, CEO de OpenAI, Elon Musk, que la tiene programada para el año que viene, o Demis Hassabis, jefe de Google DeepMind, que ve probable su descubrimiento a partir de 2030.

El matemático y científico cognitivo estadounidense Michael I. Jordan es una de las voces más autorizadas dentro del campo de la IA. Su trabajo ha sido clave para que ChatGPT, y otras máquinas de su clase, sean capaces de responder a todas las solicitudes que reciben de los usuarios. Para él, la superinteligencia es un «término inventado» que, por el momento, «ni siquiera está bien definido». Por el momento, lo considera solo un gancho para que las empresas que están en la carrera puedan captar financiación del capitalismo de riesgo.

«Creo que piensan que inteligencia artificial no suena lo bastante fuerte y convincente. Pero la idea de la superinteligencia, en realidad, tampoco significa mucho. En primer lugar, un ordenador ya puede hacer muchísimas cosas que los seres humanos no pueden hacer a nivel de cálculo o de búsqueda de evidencia. Y no está nada mal tener una herramienta que pueda hacer algunas cosas que nosotros no podemos hacer, ya que las herramientas se crean con ese propósito», afirma Jordan en conversación con ABC.

El experto remarca que no le cabe duda de que, más pronto que tarde, alguna compañía afirmará que ha creado la superinteligencia, algo que para él «no significa absolutamente nada»: «Solo espero que los periodistas seáis lo suficientemente inteligentes para preguntarles qué es lo que es eso y qué significa exactamente».

Idealistas y realistas

La mayoría de investigadores en este campo coincide en que las técnicas actuales –por muy avanzadas que parezcan– no están ni siquiera cerca de imitar bien los procesos de pensamiento y aprendizaje humanos, algo que se considera clave para hacer viable la siguiente evolución de la IA. Herramientas como ChatGPT, el Gemini de Google o el Grok de xAI, pueden funcionar bien cuando se les da una tarea clara y simple, pero no entienden el mundo de forma profunda ni aprenden con la experiencia, tal y como lo haría una persona.

Las máquinas también siguen cometiendo errores muy básicos en tareas que las personas resuelven sin dificultad, como puede ser encontrar solución a un problema visual sencillo o entender correctamente un mapa. Además, no tienen memoria duradera ni sentido común, y todo lo que ‘saben’ lo han aprendido de textos y datos que les fueron dados por los propios desarrolladores, no por experiencia directa.

Los expertos creen que si de verdad queremos crear una inteligencia que se parezca a la humana –y que la supere–, no basta con hacer modelos más grandes y con más datos. Hace falta cambiar el enfoque: diseñar sistemas que razonen mejor, que puedan recordar, que entiendan causas y consecuencias y que aprendan mientras interactúan con el mundo.

«Los más idealistas piensan que en algún momento, no se sabe muy bien cómo, todo se va a alinear para que surjan una o varias estructuras que pueden ser consideradas como inteligencia artificial general, que sería el paso previo a la superinteligencia», explica a este diario Pablo Haya, investigador del Laboratorio de Lingüística Informática de la Universidad Autónoma de Madrid y director de Businness and Language Analytics en el Instituto de Ingeniería del Conocimiento. El experto apunta que , mientras tanto, los más realistas ven la llegada de esta tecnología «como algo muy improbable en el corto plazo; porque hay muchas limitaciones que no sabemos cómo superar»: «Los sistemas de ahora, que quede claro, no son conscientes ni nos entienden. Y parece que solo escalando en datos no vamos a conseguir avanzar al siguiente escenario».

«El hombre del dinero»

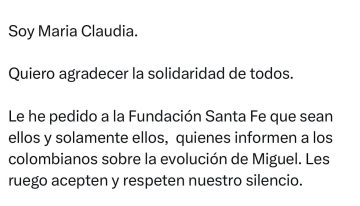

Entre las voces de los idealistas, no hay ninguna que resuene con más fuerza que la de Sam Altman. El primer ejecutivo de OpenAI ha repetido en varias ocasiones durante los últimos meses que la llegada de la máquina que supere finalmente al humano está, prácticamente, a la vuelta de la esquina. Hace apenas dos semanas lo volvió a repetir en su blog personal, en el que afirmó que «la humanidad está cerca de construir una superinteligencia digital» y vaticinó que este mismo año llegará una IA capaz de «realizar trabajo cognitivo real» pensada para la creación de código que superaría en su trabajo a los humanos, y el que viene espera que haya sistemas capaces de «descubrir nuevos conocimientos» por su cuenta.

El que no lo tiene tan claro que todo esto ocurra es el principal inversor de OpenAI, Microsoft. «Que nos autoproclamemos un hito en IA (de esa clase) es simplemente una manipulación de referencia sin sentido», afirmó Satya Nadella, CEO de la empresa propietaria de Windows, en una entrevista el pasado febrero. Estas palabras, de acuerdo con ‘The Wall Street Journal’ cayeron como un jarro de agua fría entre algunos directivos de la OpenAI. Actualmente, Microsoft y la startup se encuentran renegociando su acuerdo comercial, y precisamente, el desarrollo de la supuesta primera herramienta de IA que supere al ser humano se ha convertido en uno de los mayores puntos de fricción entre las dos firmas.

De acuerdo con el ‘Journal’, los ejecutivos de OpenAI han discutido la posibilidad de declarar que han creado la primera inteligencia artificial general con el anuncio de esa herramienta capaz de «realizar trabajo cognitivo» y mejorar a los humanos en programación que Altman tiene proyectada para este mismo año. Y esto puede ser problemático, porque según el acuerdo actual con Microsoft, la firma de ChatGPT podrá negarle el acceso a su futura tecnología en el momento en el que consiga crear una inteligencia artificial general. Eso sí, el desarrollo debe ser «de buena fe», es decir, real. En caso contrario podría comenzar una batalla legal entre las dos tecnológicas. Microsoft espera eliminar la cláusula por completo del nuevo acuerdo de colaboración que reemplazará al actual.

Pase lo que pase, llegue el anuncio de la nueva IA en los próximos meses o años, o no, Jordan desconfía notablemente de cualquier declaración que pueda hacer Sam Altman al respecto. «Solo es el hombre del dinero. No tiene una comprensión profunda de la tecnología ni piensa bien en su despliegue, y es el tipo de persona de Silicon Valley en la que no confiaría», apunta el científico.

Y eso es exactamente lo mismo que piensa Sergio Álvarez-Teleña, director ejecutivo de la empresa SciTheWorld y uno de los mayores expertos en IA que hay en España. Cuando este periódico le pregunta si la superinteligencia o la inteligencia artificial general pueden llegar de forma inmediata solo se ríe y dice que «todos los que esperan eso no tienen ni idea de lo que están diciendo. Es igual que los que dicen que la IA va a acabar con todos nosotros».

Otro camino

Álvarez-Teleña publicó hace unos meses un estudio en el que, precisamente, critica el camino que están recorriendo las empresas de Silicon Valley para que las máquinas sean capaces de superar en capacidades a los humanos. En lugar de seguir sumando más datos y potencia a los modelos existentes, a su juicio, se debe cambiar el enfoque y trabajar en la creación de muchas soluciones basadas en inteligencia artificial especializadas en distintos departamentos dentro de una empresa, llamadas ANI, y conectarlas como si fueran las distintas zonas del cerebro humano.

De dicha red podría surgir una inteligencia general auténtica pensada para la empresa y, con el tiempo, puede que una inteligencia artificial superior. Una que no estaría basada en repetir aquello con lo que ha sido entrenada, sino en aprender a razonar, actuar y adaptarse. Para ello, cree que la IA debe incorporar el conocimiento práctico de expertos humanos, entender el contexto en el que opera y tomar decisiones con sentido. En resumen, pensar, no solo completar frases como hace actualmente.

«Si conseguimos todo esto es moderadamente creíble que la superinteligencia pueda llegar al mundo de la empresa. Y sería escalable, porque la inteligencia de una empresa podría comunicarse con la de otra», apunta Álvarez-Teleña. El experto, que ha desarrollado tecnología para firmas como la red social X, J.P. Morgan o Banco Santander, ya está presentando su idea a varias compañías; aunque reconoce que todavía queda mucho trabajo para conseguir los frutos, probablemente más de una década, y eso con apoyo de la gran empresa. «Es algo que es realista, lleva tiempo y esfuerzo. No tiene nada que ver con lo que dicen los que creen que a partir de los datos que hemos puesto en internet las máquinas van a conseguir dominarnos», apunta el experto.