Los astronautas de Artemis II captan una imagen nunca vista de la Luna: se ve el mare orientale al completo

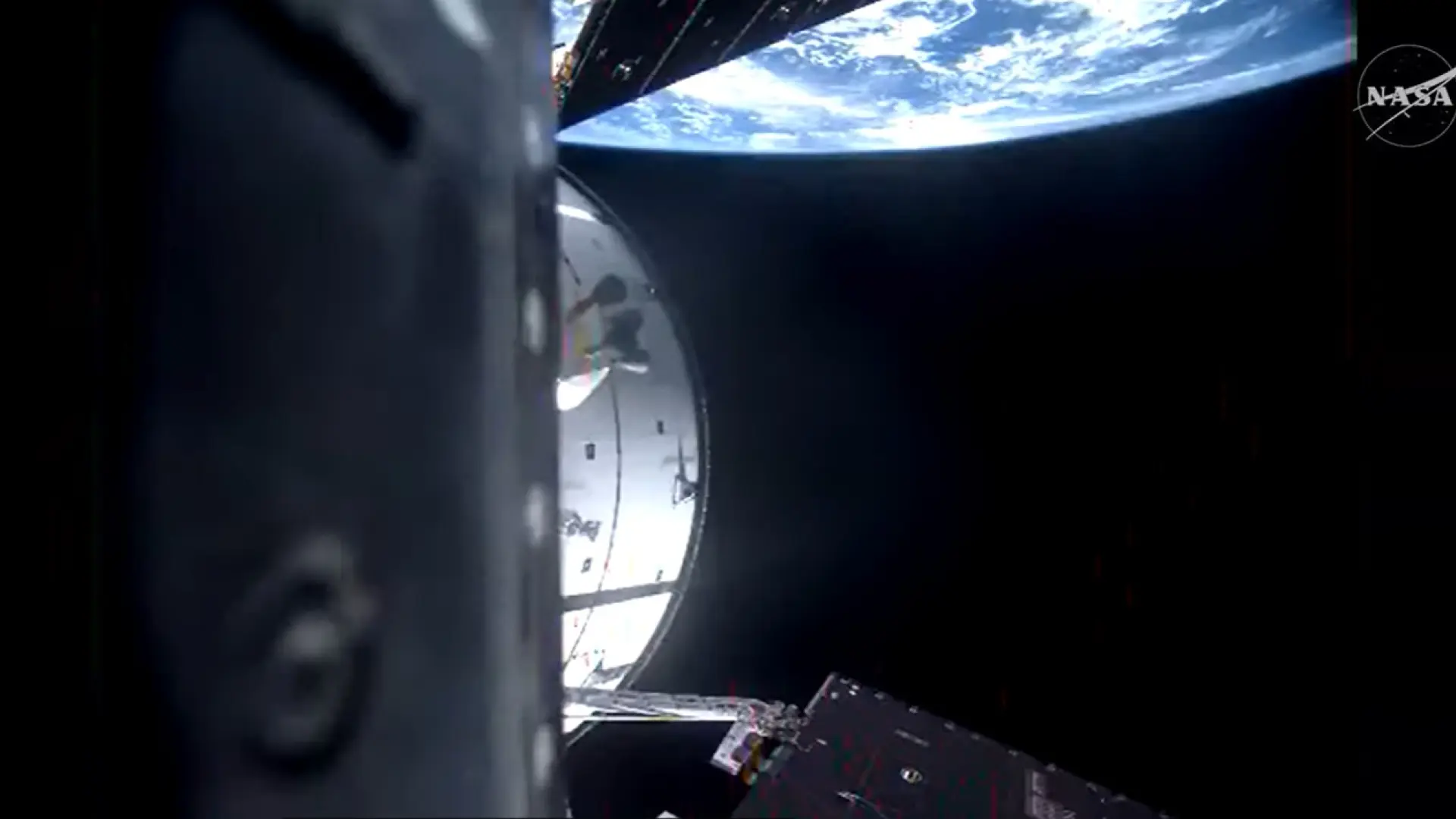

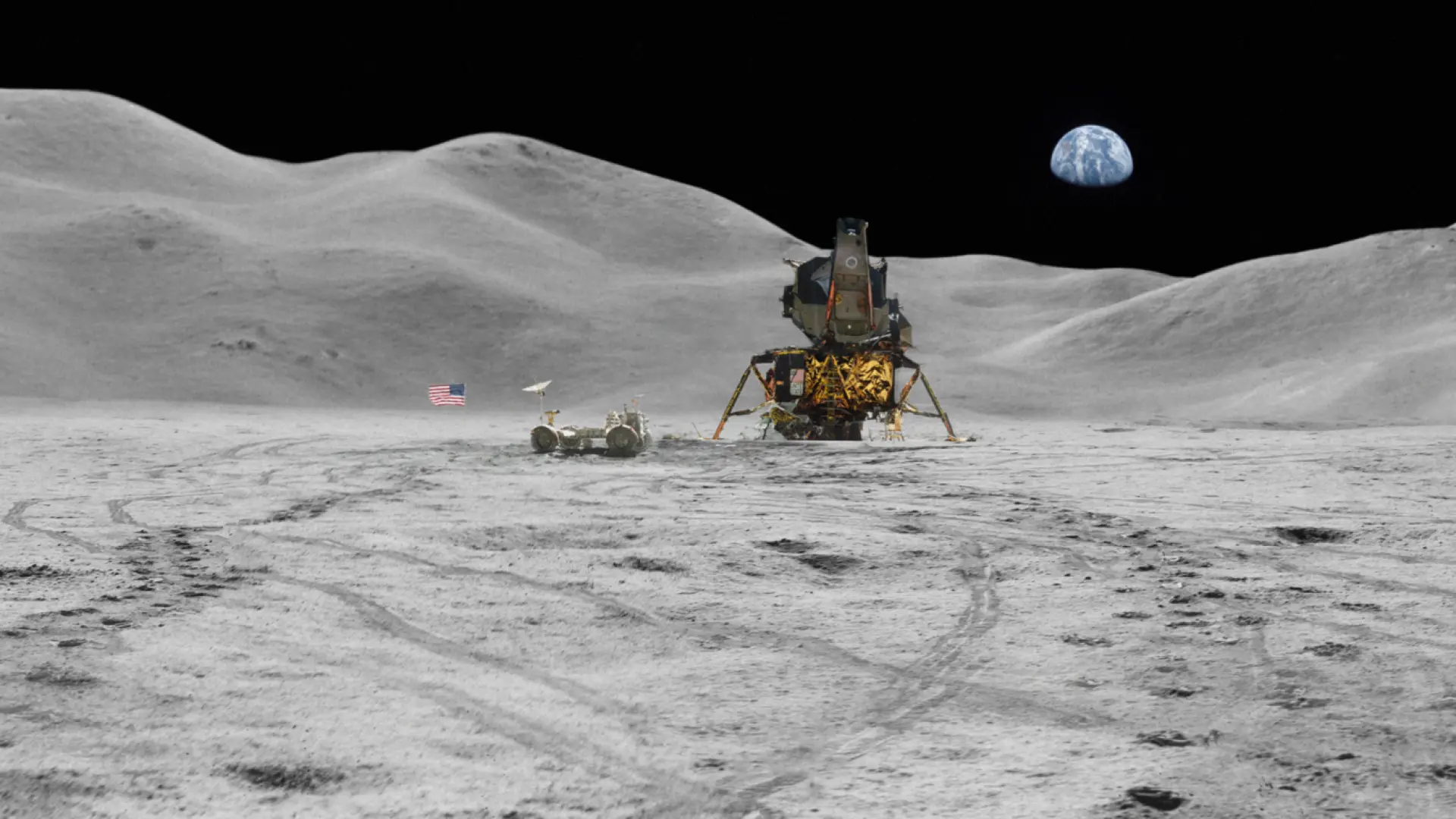

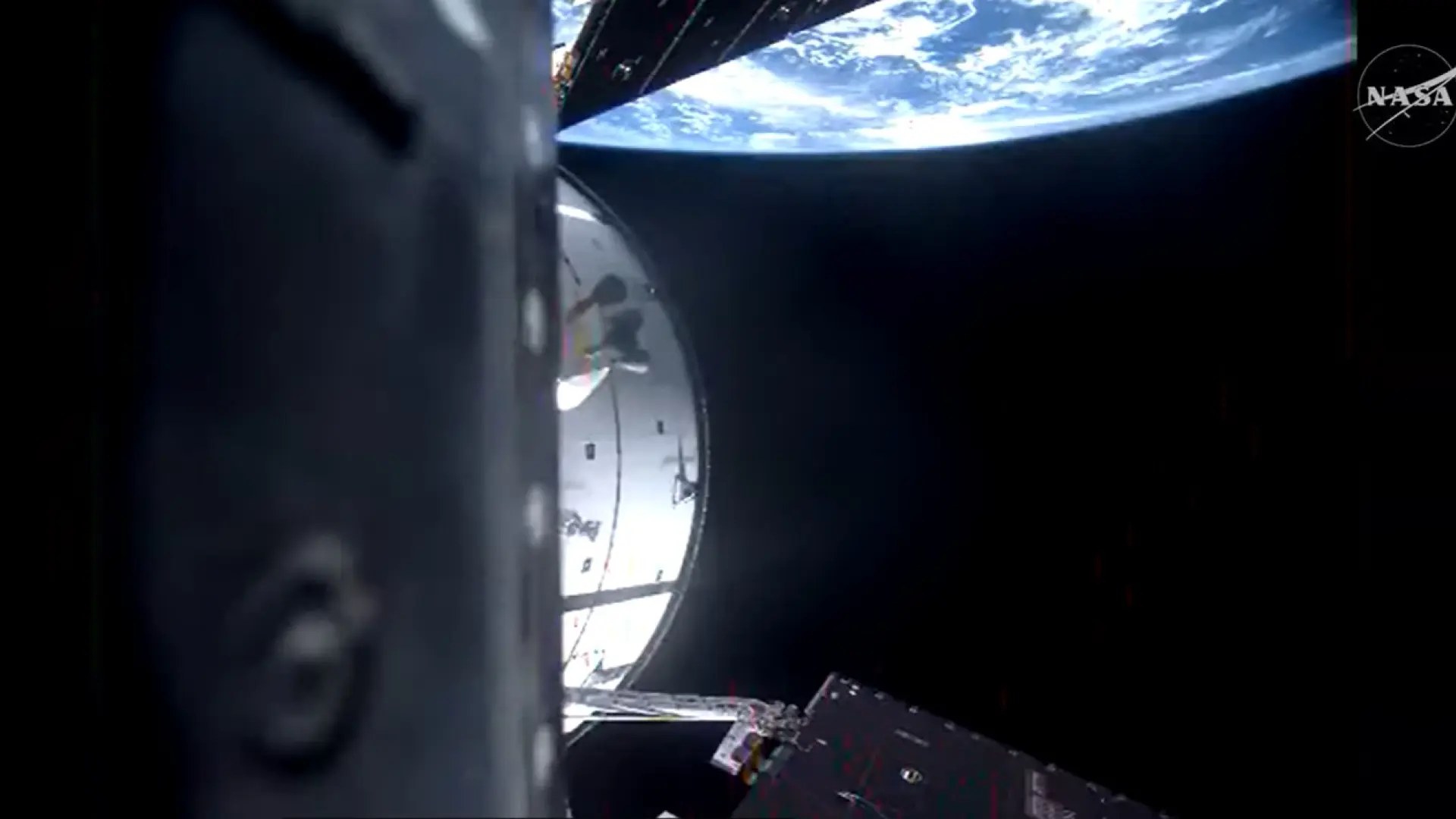

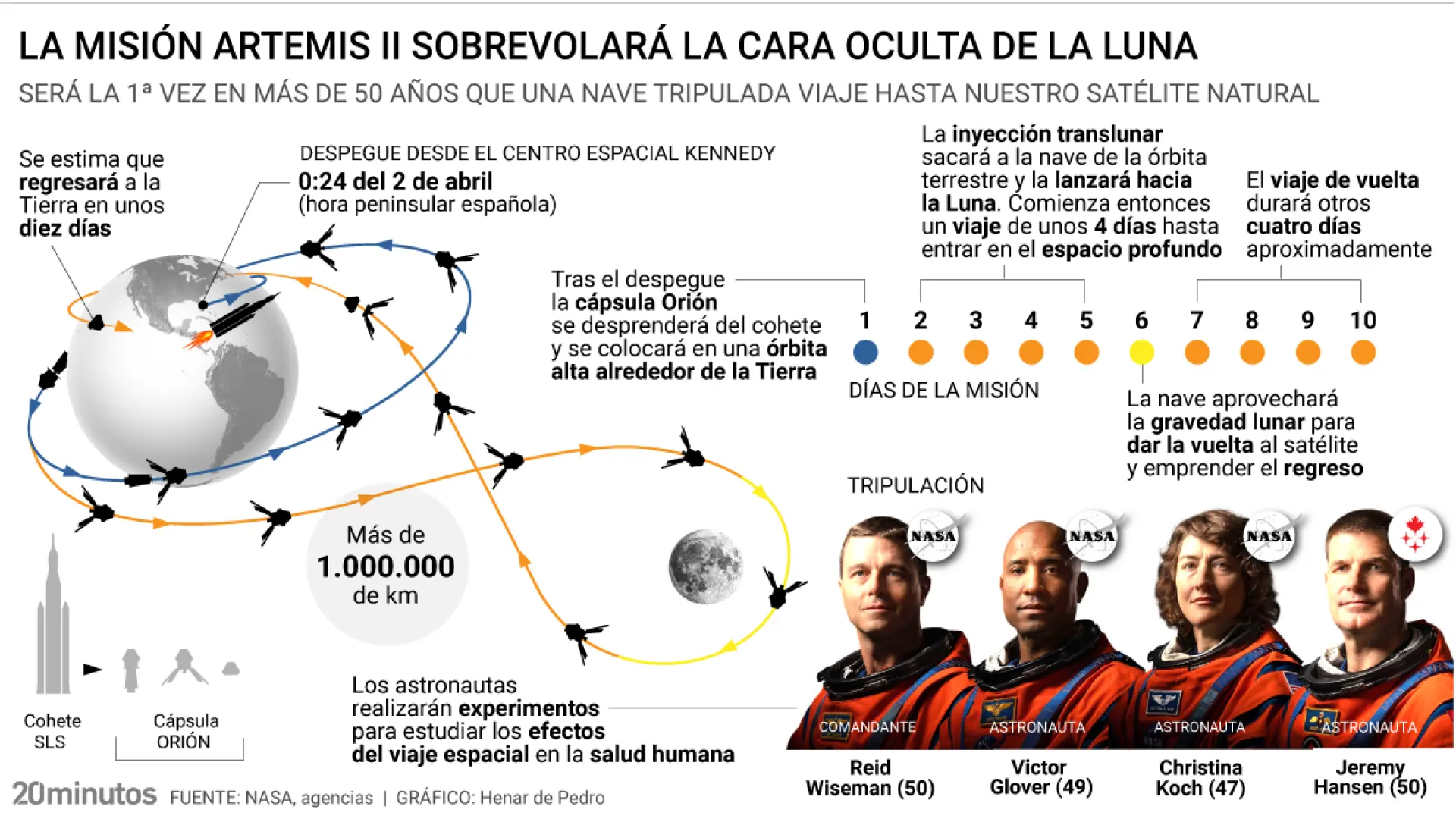

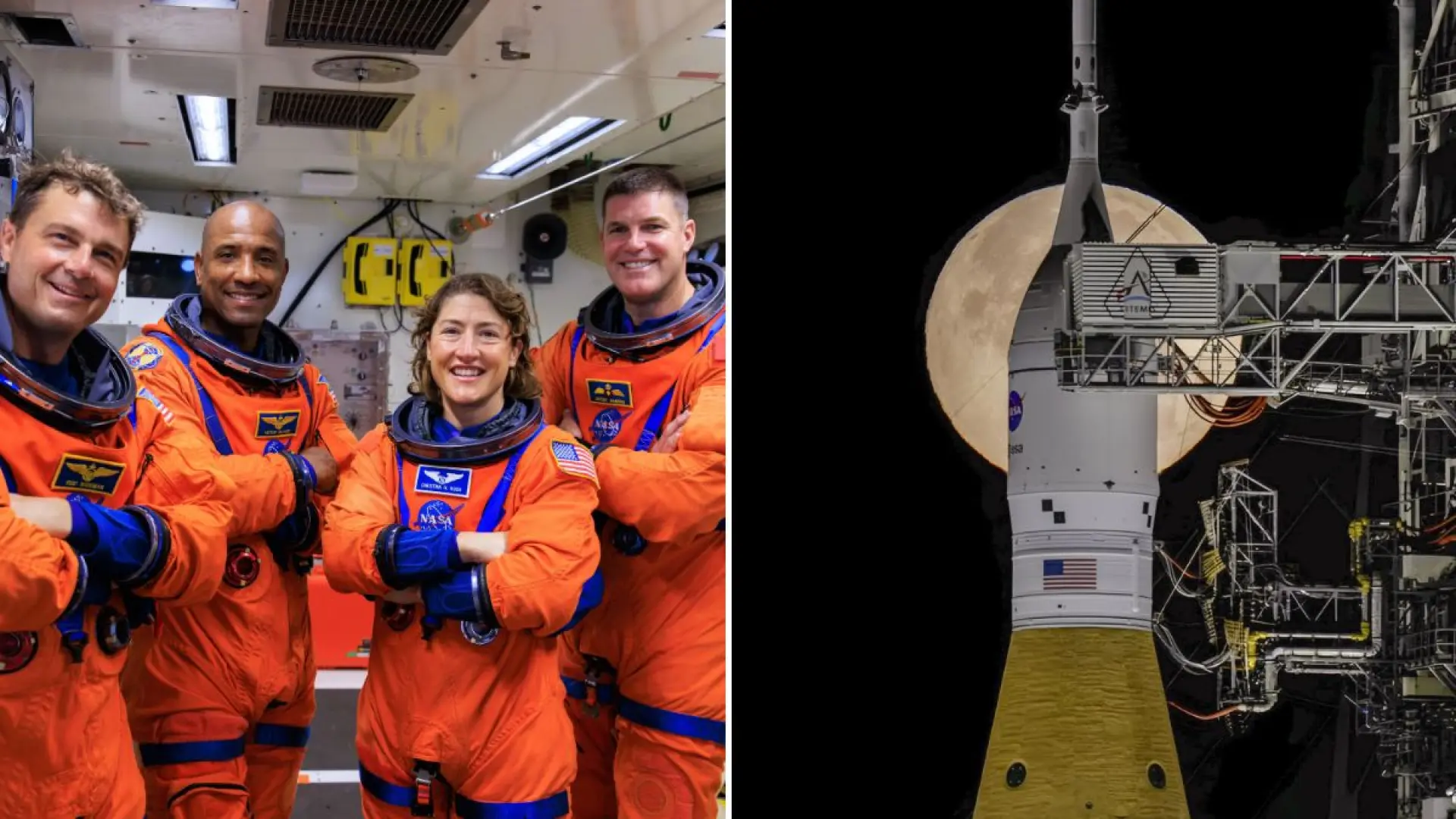

Mientras la misión Artemis II continúa su travesía hasta la Luna, los astronautas a bordo de la nave Orión han aprovechado para mostrar al mundo algunas de las imágenes que están pudiendo contemplar desde la aeronave. Entre ellas, este domingo han hecho pública una fotografía sobre el mare Orientale al completo de la Luna. La tripulación, formada así por los astronautas de la NASA Reid Wiseman, Victor Glover y Christina Koch, y el astronauta de la Agencia Espacial Canadiense Jeremy Hansen han compartido una fotografía de esta parte de la Luna que la agencia estadounidense espacial ha descrito como «la primera vez que se ha visto con los ojos humanos». «Se puede apreciar el mare Orientale en el borde derecho del disco lunar. Esta misión marca la primera vez que se observa la cuenca completa a simple vista», ha destacado la agencia espacial estadounidense en un mensaje en X. La NASA ha destacado que las imágenes representan un hito para el ojo humano y ya establece que es uno de los múltiples récords que se esperan establecer con la misión histórica que abre el camino para un futuro alunizaje.En declaraciones a la NASA, además, el comandante Wiseman ha descrito que la vista desde la nave es «verdaderamente asombrosa». «Oímos que en la Tierra aún es sábado. Hemos perdido la noción del tiempo. Tenemos la luz del Sol entrando por las ventanas y si miramos a través de ellas se puede ver una hermosa Tierra en forma de media luna con la luz del sol brillando sobre el océano y las nubes arremolinadas. Es una vista verdaderamente asombrosa», ha descrito.Entre este sábado y este domingo la tripulación está revisando una lista de las características de la superficie lunar que el equipo científico de la NASA les solicitó analizar y fotografiar durante su sobrevuelo de seis horas, previsto para la tarde del lunes 6 de abril.