Así es el Sistema de Aborto de Lanzamiento de Artemis II para salvar a los astronautas ante una explosión en milisegundos

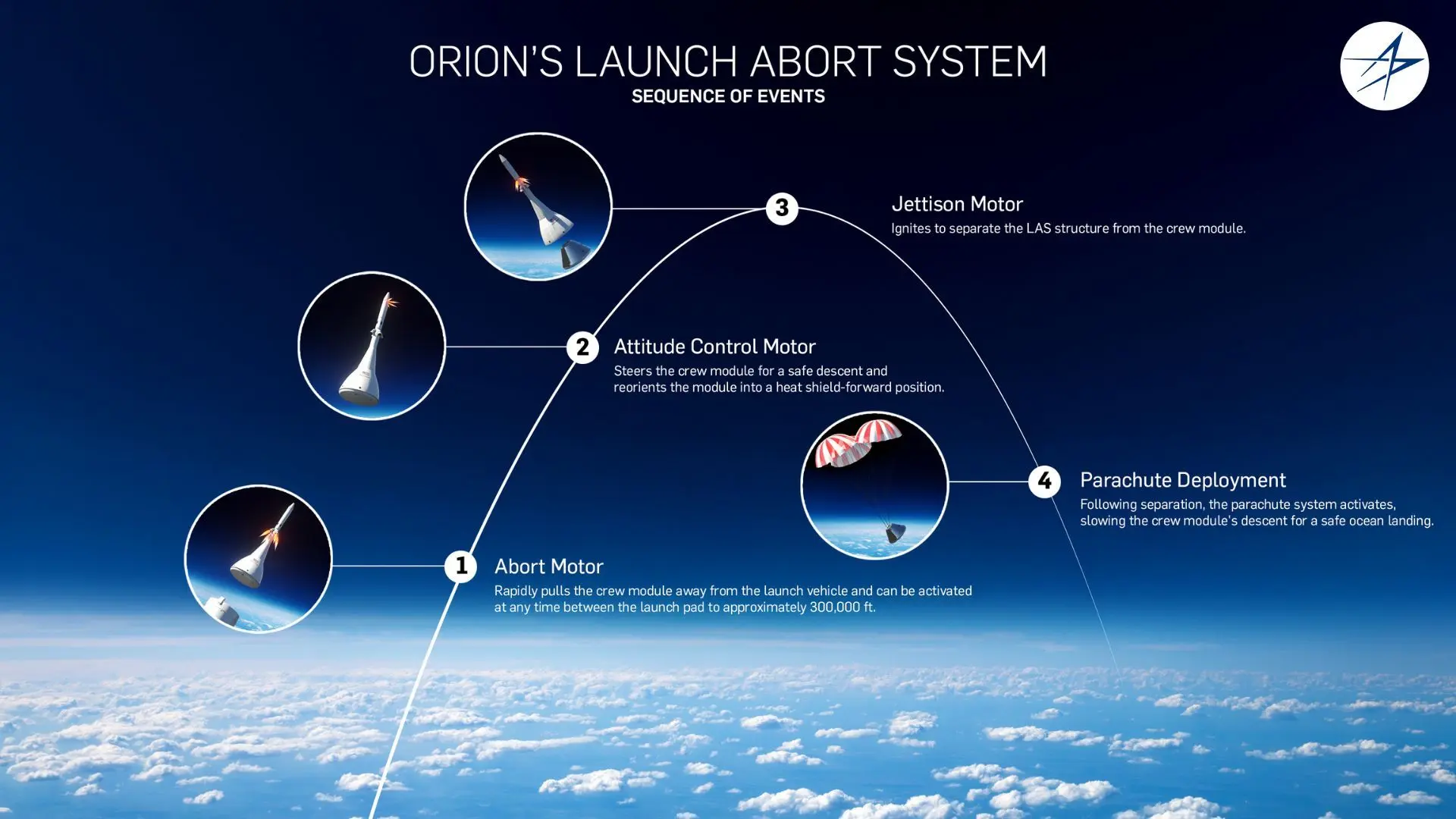

Quedan solo unos días para que la misión Artemis II viva su primera oportunidad de lanzamiento. El despegue está programado para el 1 de abril a las 18:24 (hora local de Florida), lo que en España se traducirá en la 00:24 de la madrugada del 2 de abril. A partir de ese momento, el cohete Space Launch System (SLS) tendrá dos horas para despegar desde la plataforma 39B del Centro Espacial Kennedy.El viaje durará diez días y consistirá en un sobrevuelo alrededor de la Luna. La misión seguirá una trayectoria de tipo free return, lo que permitirá que la cápsula rodee nuestro satélite y regrese a la Tierra aprovechando la gravedad lunar, sin necesidad de realizar grandes maniobras de corrección. Durante ese tiempo, la tripulación pondrá a prueba todos los sistemas en condiciones reales de espacio profundo antes de amerizar en el océano Pacífico.Pero antes de que el viaje comience, el momento de despegue es uno de los más críticos de la misión. Si todo sale según lo previsto, una vez quede confirmado el esperado lift off, el SLS impulsará a la nave Orion fuera de la atmósfera terrestre. Esta maniobra, que durará apenas ocho minutos, irá seguida de una separación de las etapas que dejará a la cápsula en una órbita inicial alrededor de la Tierra, para después poner rumbo a la Luna.¿Y si algo no sale bien? Para eso, la NASA tiene el Sistema de Aborto de Lanzamiento o LAS (Launch Abort System).Qué es el Sistema de Aborto de Lanzamiento y cómo protegerá a los astronautas de Artemis IIEn una misión tripulada, hay algo que pesa tanto como el propio cohete: la seguridad. Y ahí es donde entra en juego el Sistema de Aborto de Lanzamiento (LAS), una estructura en forma de torre situada en la parte superior de la cápsula Orion que actúa como último salvavidas si algo falla en el momento más delicado.Su función es tan simple como crítica: sacar a los astronautas del peligro en cuestión de milisegundos, como si fuera un ‘botón de eyección’.Si el cohete Space Launch System sufre una anomalía durante la cuenta atrás o en los primeros minutos de vuelo, el LAS se activa automáticamente. En ese instante, un potente motor se enciende de golpe y la cápsula se separa del cohete, saliendo disparada a gran velocidad lejos de la zona de riesgo.Todo ocurre en apenas segundos. El sistema está diseñado para generar un empuje que permita ganar distancia en muy poco tiempo, incluso antes de que una posible explosión pueda alcanzar a la tripulación. El LAS no es un único mecanismo, sino un conjunto de sistemas que actúan de forma coordinada. Primero entra en acción el motor de aborto, que tira de la cápsula fuera del cohete. Después, el motor de control de actitud se encarga de estabilizarla y orientarla correctamente durante la huida. Por último, el motor de separación desprende la torre cuando ya no es necesaria, permitiendo que la cápsula continúe su descenso y despliegue los paracaídas para amerizar con seguridad.Aunque lo ideal es que nunca tenga que activarse, el LAS está operativo desde el primer segundo del lanzamiento y permanece en alerta durante las fases más críticas.De momento, no se ha tenido que usar, pero la NASA lo ha probado en condiciones extremas, como en el ensayo Ascent Abort-2, donde demostró que puede funcionar incluso en uno de los momentos más exigentes del vuelo. Además, en la misión sin tripulación Artemis I el sistema también voló integrado, validando su comportamiento en condiciones reales.Tecnología heredada, pero mucho más avanzadaEl concepto no es nuevo. Ya se utilizó en el programa Programa Apolo, aunque el sistema actual es mucho más avanzado. Incorpora mayor potencia, una activación prácticamente instantánea y la capacidad de actuar en más fases del lanzamiento.Detrás de su desarrollo está la NASA junto a compañías como Lockheed Martin, contratista principal de la nave Orion. El LAS no evita que un cohete falle, pero sí puede evitar que ese fallo termine en tragedia. Por eso, aunque pase desapercibido frente a la espectacularidad del lanzamiento, es uno de los sistemas más críticos de toda la misión.