Publicado: febrero 6, 2025, 10:52 am

La fuente de la noticia es https://www.20minutos.es/tecnologia/ciberseguridad/deepseek-le-siguen-saliendo-problemas-ya-hay-atacantes-que-usan-para-desarrollar-codigo-malicioso-5679872/

El auge de los modelos de inteligencia artificial (IA) generativa no solo está revolucionando la creación de contenido, sino que también está facilitando nuevas tácticas para los ciberdelincuentes. Desde que se generalizó su uso, investigadores en ciberseguridad han detectado que los atacantes la utilizan para sus malas intenciones, a pesar de los esfuerzos que se hacen para luchar contra este problema, incluso desde España.

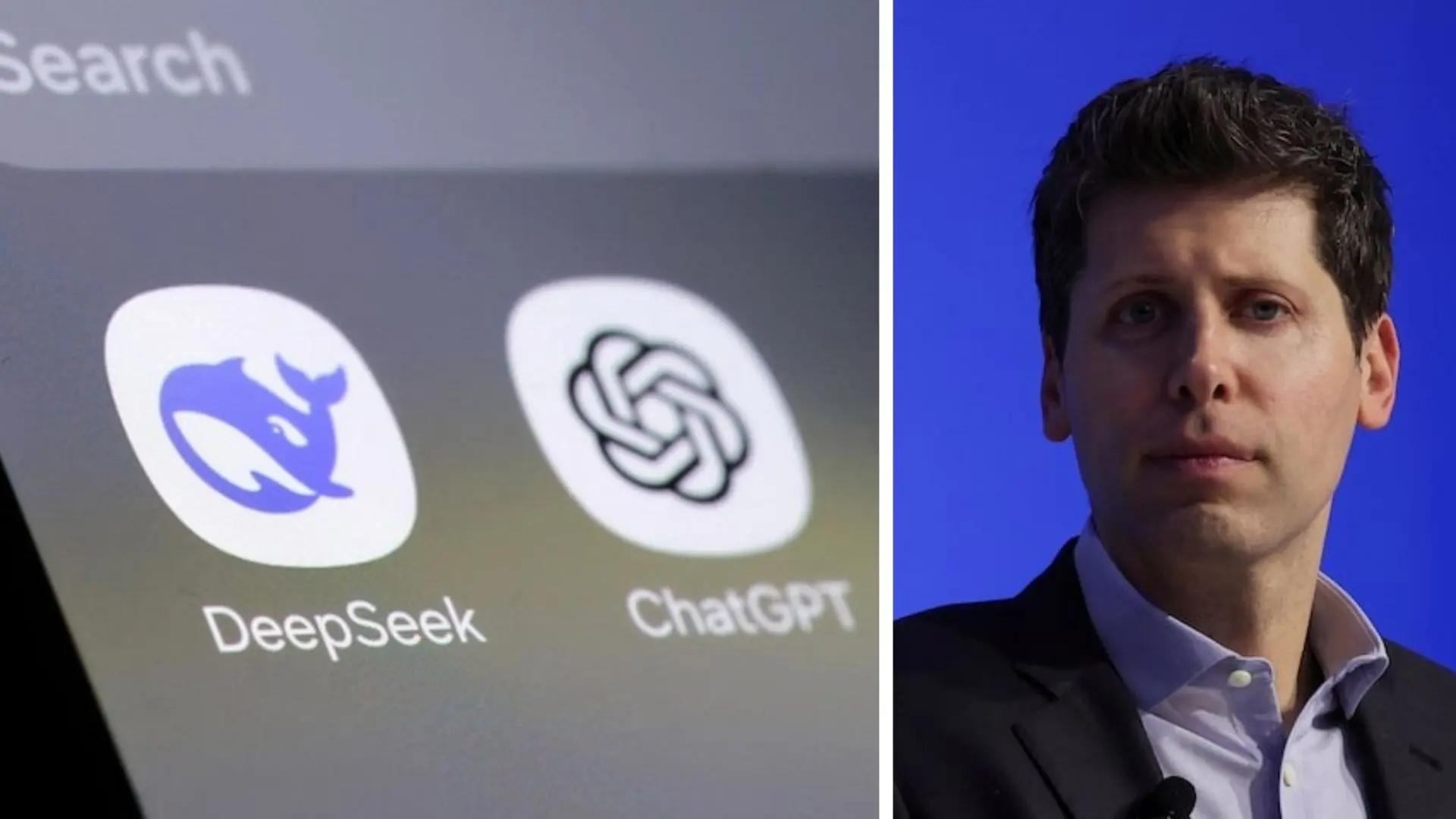

Hasta ahora, lo común era que los cibercriminales acudieran a ChatGPT para generar código malicioso. Pero hay nuevos jugadores en el tablero: DeepSeek y Qwen, dos plataformas de IA desarrolladas en China que están dando mucho que hablar durante las últimas semanas, se están popularizando entre los malos de Internet, ya que les permiten esquivar las restricciones de modelos como el de OpenAI.

Así usan la IA los ciberdelincuentes para desarrollar sus ataques

Una de las principales preocupaciones detectadas por los expertos de Check Point es el uso de técnicas de jailbreaking, que permiten manipular los modelos de IA para que ignoren sus limitaciones de seguridad. Esto facilita la generación de contenido malicioso sin censura, lo que incluye la creación de malware, fraudes financieros y estrategias avanzadas de phishing y spam.

Esta táctica se ha convertido en una de las preferidas de los ciberdelincuentes, afirman los especialistas, ya que les permite aprovechar las capacidades de la IA con fines maliciosos.

Los investigadores han identificado foros donde los ciberdelincuentes comparten métodos para vulnerar DeepSeek y Qwen, con guías detalladas sobre las distintas formas de jailbreaking, cómo eludir las protecciones antifraude y cómo desarrollar malware propiamente dicho.

Asimismo, han detectado “múltiples discusiones y técnicas compartidas” sobre el uso de DeepSeek para eludir las protecciones antifraude de los sistemas bancarios, lo que indica “el potencial de importantes robos financieros”.

Menos restricciones que ChatGPT: un atractivo para los atacantes

Desde Check Point explican que “ChatGPT ha invertido sustancialmente en medidas antiabuso en los dos últimos años”, pero que “estos modelos más recientes parecen ofrecer poca resistencia al uso indebido, lo que atrae el interés de atacantes de distintos niveles, especialmente los poco cualificados, es decir, individuos que explotan scripts o herramientas existentes sin un conocimiento profundo de la tecnología subyacente”.

Por otro lado, recuerda que “ya existen versiones no censuradas de ChatGPT en varios repositorios de Internet”, de manera que a medida que estos nuevos modelos de IA ganen popularidad, “es previsible que aparezcan versiones equivalentes de DeepSeek y Qwen, lo que aumentará aún más los riesgos”.

Apúntate a nuestra newsletter y recibe en tu correo las últimas noticias sobre tecnología.